Jak moc se máme bát technologií vycházejících z umělé inteligence v rukou zločinců? Studie v magazínu Crime Science je klasifikuje podle míry společenské nebezpečnosti, možnosti finančních ztrát a také hodnotí, jak těžké je jim čelit. Studie byla zakončena dvoudenním workshopem nazvaným AI & Future Crime se zástupci akademické obce, policie, obranných složek, vládního a soukromého sektoru. Čeho se tedy v oblasti vyspělé kriminality poháněné umělou inteligencí máme nejvíce obávat?

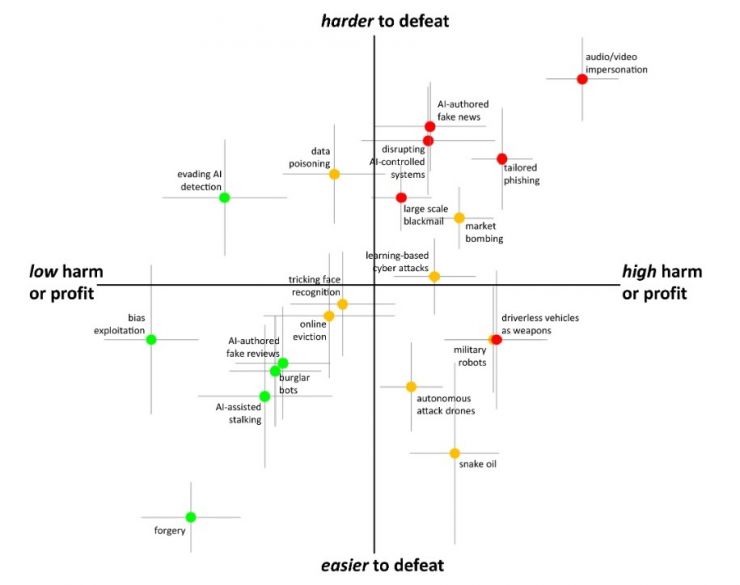

Mezi nejvážnějšími hrozbami figurují falešné audio- a videozáznamy, využití samořiditelných vozidel jako zbraní, phishing šitý obětem na míru, útoky na systémy řízené umělou inteligencí, vydírání ve velkém měřítku a fake news generované umělou inteligencí. Za středně závažné hrozby jsou považováni vojenští roboti, prodej podvodných služeb (snake oil), manipulace s daty ze strojového učení, inteligentní kyberútoky, autonomní útočné drony, zamezení přístupu k online službám, podvody se systémy rozpoznávání obličeje a útoky na finanční či akciové trhy. Ke slabým hrozbám analytici řadí zkreslování algoritmů, zlodějské roboty, vyhýbání se detekci umělou inteligencí, recenze generované umělou inteligencí, stalking pomocí umělé inteligence a padělání autorských děl.

Jaké hrozby představují technologie s umělou inteligencí v rukou zločinců? Graf podle AI-enabled future crime

Podrobnější pohled si zaslouží nejvážnější hrozby, jejichž nebezpečnost spočívá v tom, že je s nimi těžké bojovat a přinášejí vysoký zisk zločincům nebo ohrožení společnosti. Lidé jsou zvyklí věřit svým očím a uším, takže video- či audiozáznamy často považují za jasné zobrazení pravdy. Sítě GAN (Generative adversarial networks) v propojení s deep learningem mohou vygenerovat tak přesvědčivá videa, že není v lidských silách zhodnotit jejich pravost. Telefonát s vygenerovaným hlasem může zmást kohokoliv a po získání důvěry oběť v klidu prozradí citlivé údaje, a krádeže identity tak dostávají úplně jiný rozměr. Diskreditace důkazů je potom v rukách kriminálníků silnou zbraní s vysokou společenskou nebezpečností.

Neřízená vozidla

Vozidla byla využívána k teroristickým činům odjakživa. Autonomní vozidla řízená umělou inteligencí mohou být s přihlédnutím k průběhu teroristických útoků posledních let smrtící zbraní, zvlášť až se začnou používat plně autonomní zařízení, která se pohybují sama po veřejných komunikacích. Teroristům zde nejde o zisk, ale o co největší škody na majetku a životech.

Cíli teroristů se pravděpodobně stanou systémy odpovědné za všechny aspekty veřejné bezpečnosti, stejně jako systémy dohledu nad finančními transakcemi.

Phishing, tedy podvodné získávání citlivých údajů, není jenom primitivním naváděním ke klikání na podvodné linky a ztrátě hesel. Umělá inteligence umí asistovat v přípravě velmi sofistikovaných a personifikovaných útoků, které se tváří jako zprávy z banky. Ty začínají být k nerozeznání od originálu a je čím dál těžší jim nepodlehnout. Nebezpečnost phishingu spočívá v možných obrovských finančních ztrátách.

Cílem zločinců a teroristů mohou být i systémy umělé inteligence založené na strojovém učení a využívané ve státní infrastruktuře. Útoky mohou skončit například výpadky energetické sítě, dopravními zácpami při útoku na telematické systémy nebo narušení logistiky distribuce potravin. Klíčovými cíli teroristů se pravděpodobně stanou systémy odpovědné za všechny aspekty veřejné bezpečnosti, stejně jako systémy dohledu nad finančními transakcemi.

Výnosné online vydírání

Umělou inteligenci lze také použít k vytvoření falešných důkazů při online vydírání. Vydírání ve velkém měřítku bylo analytiky hodnoceno jako vysoce ziskové, stejně jako phishing šitý oběti na míru. Poměrně známou praktikou je pak sextortion, tedy nepravdivé tvrzení, že vydírající má kompromitující videozáznam z hacknutého počítače nebo telefonu uživatele.

Jak víme, tak fake news se snaží tvářit jako pravdivé informace z důvěryhodného zdroje a ve větším množství mohou odvádět pozornost od informací pravdivých. Umělou inteligenci lze použít ke generování mnoha verzí konkrétního obsahu, a to i z více zdrojů, aby se zvýšila jeho viditelnost a důvěryhodnost. Fake news umějí nadělat velkou škodu, například ovlivnit politické dění, přesto ale nejsou řazeny mezi vysoce ziskové zločinecké praktiky.

Reklama

foto: Shutterstock, zdroj: Crime Science