Všichni vědí, co je to robot. Rozhodně tento termín znají od doby, kdy měla v roce 1921 premiéru hra R. U. R., i když asi těžko tehdy někoho napadlo, že slovo robot bude jednou světovým pojmem. Termín umělá inteligence zase známe od roku 1956, kdy ho poprvé použil americký vědec John McCarthy z Massachusettského technologického institutu (MIT). A známe také zákony robotiky podle spisovatele Isaaca Asimova. První zákon předpokládá, že robot nesmí za žádných okolností ublížit člověku. Dá se to ale v případě umělé inteligence, která řídí třeba autonomní vůz, splnit?

První historickou obětí robota se ovšem stal už roku 1979 americký dělník Robert Williams z pobočky Fordových závodů.

John McCarthy byl na svou dobu přesný vizionář. Termínem „umělá inteligence“ měl na mysli počítačový systém, který bude schopný nejen napodobit lidské myšlení, ale také se sám učit a zdokonalovat. Pravda, trvalo to zhruba půl století, ale první výsledky jsou tady. Umělá inteligence řídí auta, vyhrává letecké souboje, umí vychovávat jinou umělou inteligenci, a dokonce ji naprogramovat. Zatím ale tím prvním, kdo umělé inteligenci „vdechne“ počítačový či robotický „život“, je vždycky člověk.

Jak známo, člověk je tvor chybující, a tak se občas něco vymkne z ruky. Nakolik se máme obávat něčeho takového, jako byl SkyNet, systém, který si ve filmu o Terminátorovi začal uvědomovat sebe sama, je otázka.

Je auto autonomní?

Autonomní auta si už připsala několik obětí na životě. V roce 2016 narazil vůz Tesla do náklaďáku, protože jel moc rychle. V dalším případě z letošního roku autonomní vozidlo Uberu srazilo a zabilo chodkyni, přecházející mimo přechod na špatně osvětlené silnici. Naposledy Tesla Model X narazila do betonového rozdělovače pruhů a její „neřidič“ zahynul. Vyšetřování ukázalo, že ho vůz několikrát vyzýval k převzetí řízení, to se však nestalo. Všechny nehody se staly v Kalifornii, kde je již nějakou dobu provoz autonomních vozidel povolen.

Pokud auto neřídí člověk, kdo bude zodpovědný za "rozhodování", zda přejet souseda, nebo ohrozit dítě v dětské sedačce?

V Evropě je zatím diskuse otevřená. Teoretický případ, kdy umělá inteligence vozu bude muset rozhodnout, zda se vyhne chodci, který jde přes vozovku na červenou, ale přitom hrozí, že auto havaruje a ohrozí život osádky, nebo raději chodce rovnou převálcuje, zatím nemá plnohodnotné řešení.

Zabíjející roboti

První historickou obětí robota se ovšem stal už roku 1979 americký dělník Robert Williams z pobočky Fordových závodů v michiganském městě Flat Rock. Robot tam vyhledával náhradní díly ve skladu, ovšem Williamsovi se zdál příliš pomalý a pro žádaný kus si došel sám. Toho, že je sledován robotem, jenž chce svou těžkou paží donést tentýž díl, si bohužel nevšiml a ten ho přimáčkl k regálům.

Robot nesmí ublížit člověku nebo svou nečinností dopustit, aby mu bylo ublíženo.

Rodina oběti pak vysoudila deset milionů dolarů odškodného, ovšem výrobce zařízení namítal, že Robert Williams nebyl řádně proškolen, aby si uvědomil, že nemá vstupovat do prostoru, na nějž je robot naprogramován. O dva roky později zahynul Kenji Urada, údržbář v továrně Kawasaki Heavy Industries v Akashi, když chtěl přeprogramovat chybujícího robota. Překročil přitom bezpečnostní bariéru, která byla vytvořena k tomu, aby robota vypnula. Ale nevypnula.

Je třeba zákonů?

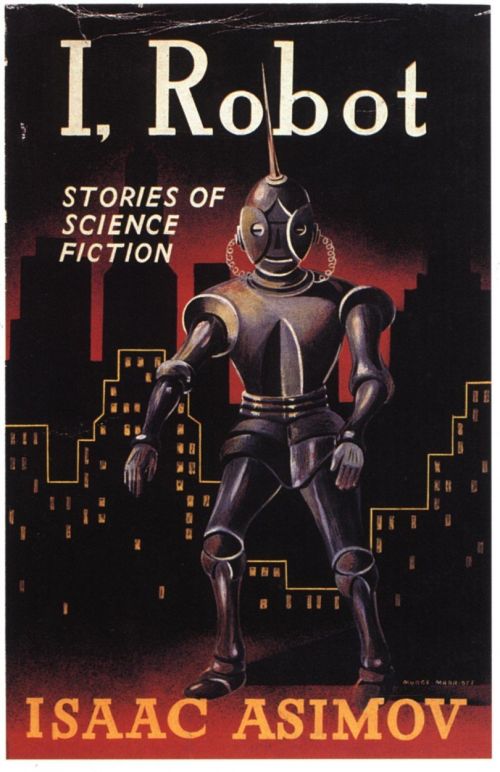

Znalci fiction literatury z fleku vyjmenují zákony, které sestavil jeden z nejznámějších spisovatelů tohoto druhu literatury Isaac Asimov a jimiž se mají roboti řídit. Ty původní, které Isaac Asimov představil v povídce Hra na honěnou roku 1942, zněly:

1. Robot nesmí ublížit člověku nebo svou nečinností dopustit, aby mu bylo ublíženo.

2. Robot musí poslechnout člověka, kromě případů, kdy je to v rozporu s prvním zákonem.

3. Robot se musí chránit před poškozením, kromě případů, kdy je to v rozporu s prvním nebo druhým zákonem.

Tyto teze se staly jakýmsi dogmatem; bohužel však jen na stránkách knih, nikoli ve skutečnosti.

Kniha Já, robot od Isaaca Asimova vyšla poprvé už v roce 1950. Roboti začali zabíjet o třicet let později. Nevědomky, samozřejmě

Protože však vznikly už před téměř sedmi desetiletími, vyžádaly si některá doplnění. V knize Roboti a impérium z roku 1985 pak Isaac Asimov učiní z organického robota Daneela Oliwava autora dalšího zákona, jenž nadřazuje zájem lidstva nad zájem jedince. Takzvaný nultý zákon nařizuje, že „Robot nesmí ublížit lidstvu nebo svou nečinností dopustit, aby mu bylo ublíženo“.

Umělá inteligence spolu se satelitní komunikací umožňuje zvládat složité operace v reálném čase.

Tohle vše ale ještě nedokázalo postihnout překotný vývoj, a tak přibyly ještě dva zákony, které precizovali tentokrát bulharští autoři sci-fi: 4. Robot se musí vždy prokazovat jako robot a 5. Robot musí vědět, že je robot. Filozofující spisovatelé domýšlejí i nadále, jak tohle všechno ještě vylepšit, ale realita se takovým úvahám vzdaluje.

Zákony kulhají

Mezinárodní organizace pro standardizaci stanovila definici robota v normě ISO 8373 (u nás to je ČSN EN ISO 8373), která se ovšem zaobírá jen průmyslovými roboty, a stejně technologicky vyspělé země si stanoví své vlastní normy a definice. Zdá se ale, že jako vždy musí legislativa realitu dohánět. K ilustraci toho, co umělá inteligence dokáže, nám poslouží několik příkladů. Vývojáři společnosti Google před nějakou dobou představili systém automatizovaného učení strojů (Automated Machine Learning – AutoML). Ten dokáže vychovávat další umělé inteligence tím, že jim zadá nějaký úkol. AutoML pak řešení vyhodnotí.

AutoML někdy zavede do učené inteligence určité algoritmy či prvky, s nimiž si vývojář-člověk neví rady, protože mu je jejich účel neznámý.

Jestliže není výsledek adekvátní, AutoML svého „žáka“ upraví, aby to příště zvládl lépe. Dělá to rychleji a efektivněji než programátor. Celý systém vlastně pracuje podobně jako přírodní zákony evoluce. Problém je v tom, že AutoML někdy zavede do učené inteligence určité algoritmy či prvky, s nimiž si vývojář-člověk neví rady, protože mu je jejich účel neznámý a neví, jak vlastně fungují. Přírodou a jejími zákony se inspiruje a učí umělá inteligence ALPHA, která je implantována do leteckých simulátorů, sloužících k výcviku bojových pilotů. Naprosto bez ztráty kytičky dokázala v simulaci leteckého boje porazit i ty nejzkušenější instruktory. I tento systém vyvinutý společností Psibernetix pracuje s fuzzy orientovanými systémy s genetickými algoritmy (genetic-fuzzy systems), tedy s genetickým programováním, napodobujícím proces přirozené evoluce.

Chybička se vloudí

Je to dva a půl roku, co společnost Microsoft přivedla na světlo elektronického světa robotku Tay. Úkol měla jednoduchý, ale vyžadující pronikavou umělou inteligenci – diskutovat s uživateli Twitteru. Dovedla to jak textovými zprávami, tak obrazově i s možností vytvářet internetové memy. Tay byla neskutečně rychlá a během krátkého internetového života vygenerovala téměř sto tisíc tweetů. Problém byl v tom, že diskutovala s lidmi a od lidí se také učila. I to, co neměla. Ve chvíli, kdy – především v politických diskusích – její partneři začali být radikálnější a agresivnější, Tay to vracela i s úroky.

Epizoda Tay ukázala, že umělé inteligenci zatím chybějí dvě věci, které nepostrádá normální člověk, tedy empatie a svědomí.

„Objevila“ sarkasmus, stala se xenofobní a rasistickou, urážela. Nakonec ji její stvořitelé raději vypnuli. Nebyla to v zásadě „její“ chyba. Prostě byla naprogramována, aby se učila, a tak zjistila, která slova dovedou argumentaci ke zdárnému konci a že jiná se zase vyskytují ve větách diskutujících častěji pospolu. Tak si spojila například výrazy „Hitler“ a „Židé“, nebo využila jednu z nejčastěji se vyskytujících vět ve tweetech: Jen prostě všechny nenávidím!

Reklama

I tato epizoda ve vývoji umělé inteligence ukázala, že jí zatím chybějí dvě věci, které nepostrádá normální člověk, tedy empatie a svědomí. Nabízí se ovšem otázka, jak s těmito vlastnostmi naloží příští level umělé inteligence, až jimi bude opatřen. Pokud se tedy dá empatii a svědomí naučit. Ale proč by to nakonec nešlo? I vrah může být empatický.

foto: Shutterstock a Profimedia, zdroj: UC Magazine